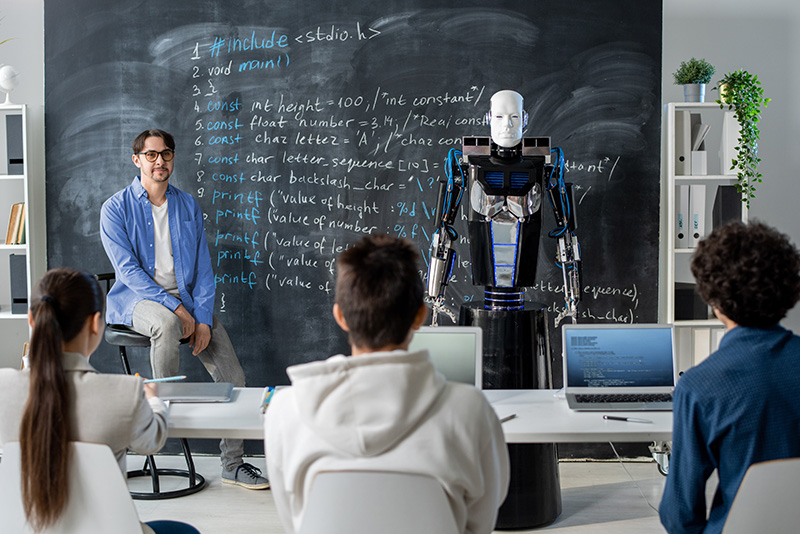

يشهد التعليم ثورة رقمية بفضل الذكاء الاصطناعي (AI)، الذي يعيد تعريف كيفية تعلّم الطلاب وكيفية تعليم المعلمين. من إنشاء مسارات تعليمية مخصصة إلى التحليلات التنبؤية، يساهم الذكاء الاصطناعي في جعل التعليم أكثر سهولة وكفاءة وإثارة. ومع ذلك، فإن هذا الابتكار يأتي مع مسؤولية كبيرة. يثير استخدام الذكاء الاصطناعي في التعليم تساؤلات أخلاقية هامة حول الخصوصية والتحيز والشفافية والوصول العادل. يستكشف هذا المقال هذه القضايا الأخلاقية ويقدم رؤى حول كيفية التغلب على التحديات مع الاستفادة من إمكانات الذكاء الاصطناعي.

قبل التطرق إلى الاعتبارات الأخلاقية، من المهم فهم الفوائد التي يقدمها الذكاء الاصطناعي للتعليم:

على الرغم من هذه الفوائد الثورية، إلا أن هناك تحديات أخلاقية تتطلب معالجة دقيقة.

يعتمد الذكاء الاصطناعي في التعليم بشكل كبير على جمع البيانات، بما في ذلك المعلومات الشخصية وعادات التعلّم وحتى الاستجابات العاطفية. وهذا يثير أسئلة مثل:

أفضل الممارسات: ينبغي للمدارس والمنصات اعتماد تدابير قوية لحماية البيانات، والامتثال لمعايير الخصوصية العالمية مثل اللائحة العامة لحماية البيانات GDPR (كلاسبلي متوافقة مع اللائحة العامة لحماية البيانات)، والتواصل بشكل واضح حول كيفية جمع البيانات واستخدامها وتخزينها.

أنظمة الذكاء الاصطناعي تعتمد على البيانات التي يتم تدريبها عليها. إذا كانت هذه البيانات تحمل تحيزات، فإن هذه التحيزات قد تظهر في:

أفضل الممارسات: يجب على المطورين مراجعة واختبار خوارزميات الذكاء الاصطناعي بانتظام لتحديد التحيزات ومعالجتها. استخدام مجموعات بيانات متنوعة وتصاميم شاملة أمر ضروري لضمان الإنصاف.

تعمل أنظمة الذكاء الاصطناعي في كثير من الأحيان كـ "صناديق سوداء"، حيث يتم اتخاذ القرارات دون شرح واضح. في التعليم، يمكن أن يؤدي ذلك إلى انعدام الثقة بين الطلاب وأولياء الأمور والمعلمين.

أسئلة رئيسية:

أفضل الممارسات: يجب أن تكون الشفافية مبدأً أساسياً. يجب أن يتمكن المعلمون والطلاب وأولياء الأمور من فهم كيفية عمل أنظمة الذكاء الاصطناعي والمعايير التي تستخدمها لاتخاذ القرارات.

على الرغم من أن الذكاء الاصطناعي لديه القدرة على دمقرطة التعليم، إلا أنه قد يزيد من عدم المساواة:

أفضل الممارسات: يجب على الحكومات والمؤسسات والمطورين التعاون لضمان أن تكون أدوات الذكاء الاصطناعي ميسورة التكلفة وشاملة لجميع المتعلمين بغض النظر عن خلفياتهم الاجتماعية أو قدراتهم.

يمكن للذكاء الاصطناعي أن ينجز المهام الآلية ويوفر التعليم، لكنه لا يمكنه استبدال العنصر البشري في التعليم. الإفراط في الاعتماد على الذكاء الاصطناعي قد يقلل من دور المعلمين كمرشدين ومحفزين ومفكرين نقديين.

أفضل الممارسات: يجب النظر إلى الذكاء الاصطناعي كأداة تعزز دور المعلمين بدلاً من استبدالهم. ينبغي أن تتضمن البرامج التدريبية تعليم المعلمين كيفية دمج الذكاء الاصطناعي في ممارساتهم بشكل فعال.

يتطلب تحقيق التوازن بين الابتكار والأخلاقيات تعاون جميع الأطراف المعنية—المعلمين والطلاب والمطورين وصناع السياسات وأولياء الأمور. إليك بعض الخطوات لضمان استخدام الذكاء الاصطناعي في التعليم بشكل أخلاقي:

يمتلك الذكاء الاصطناعي القدرة على تغيير التعليم، مما يجعله أكثر تخصيصاً وكفاءة وسهولة في الوصول من أي وقت مضى. ومع ذلك، فإن إمكاناته لا يمكن تحقيقها بالكامل إلا إذا وُضعت الاعتبارات الأخلاقية في المقدمة. من خلال معالجة مخاوف الخصوصية والتحيز والشفافية والإنصاف، يمكننا إنشاء مستقبل يعزز فيه الذكاء الاصطناعي التعليم دون المساس بالقيم التي تجعل التعلّم تجربة إنسانية متميزة.

بينما نحتضن الذكاء الاصطناعي في التعليم، يجب أن يكون الهدف ليس فقط الابتكار، بل أيضاً المسؤولية. معاً، يمكننا بناء نظام تعليمي لا يكون فقط متقدماً ولكنه أيضاً عادلاً وشاملاً وأخلاقياً، مما يضمن أن يتمتع كل متعلم بفرصة النجاح في عالم تقوده تقنيات الذكاء الاصطناعي.